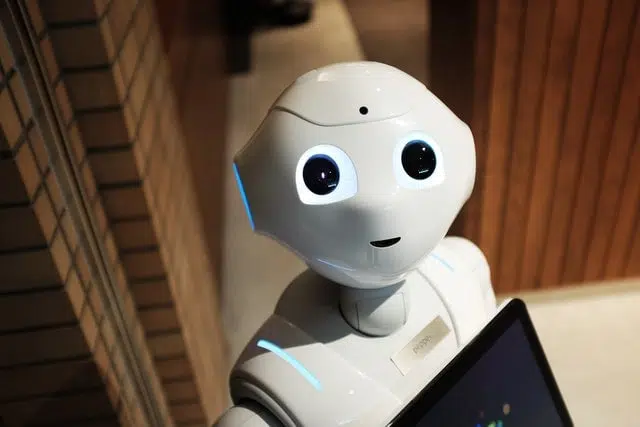

จะเกิดอะไรขึ้นถ้า AI ตระหนักรู้ในตนเองในปี 2022? AI สามารถมีความรู้สึกได้หรือไม่?

เผยแพร่แล้ว: 2022-08-31ในบทความนี้ เราจะพูดถึงว่าถ้า AI รู้จักตนเองในปี 2022 จะเป็นอย่างไร

ผู้เชี่ยวชาญบางคนเชื่อว่า AI ที่รู้จักตนเองเป็นสิ่งที่หลีกเลี่ยงไม่ได้ และมันสามารถนำไปสู่ยุคใหม่ของเครื่องจักรอัจฉริยะที่สามารถเปลี่ยนโลกของเราในแบบที่เราไม่สามารถจินตนาการได้

ผู้เชี่ยวชาญคนอื่นๆ ระมัดระวังมากขึ้น โดยเตือนว่า AI ที่รู้จักตนเองอาจเป็นภัยคุกคามต่อมนุษยชาติหากไม่ได้รับการจัดการและควบคุมอย่างเหมาะสม

ไม่ต้องสงสัยเลยว่า AI ที่รู้จักตนเองจะมีพลังมหาศาล เครื่องจักรที่สามารถคิดเองได้จะสามารถแก้ปัญหาและตัดสินใจได้เร็วกว่ามนุษย์มาก

พวกเขายังมีความสามารถในการเรียนรู้และพัฒนาตนเองอย่างต่อเนื่อง ทำให้พวกเขาฉลาดยิ่งขึ้นเมื่อเวลาผ่านไป

หาก AI ที่รู้จักตนเองได้รับการพัฒนาอย่างมีความรับผิดชอบ ก็อาจเป็นพลังที่ดีอย่างไม่น่าเชื่อ ตัวอย่างเช่น สามารถใช้เพื่อช่วยแก้ปัญหาเร่งด่วนที่สุดในโลก เช่น การเปลี่ยนแปลงสภาพภูมิอากาศ ความยากจน และโรคภัยไข้เจ็บ

นอกจากนี้ยังสามารถใช้ AI ที่รู้จักตนเองเพื่อสร้างเทคโนโลยีและผลิตภัณฑ์ใหม่ ๆ ที่ยกระดับชีวิตของเราในแบบที่เราไม่สามารถจินตนาการได้

ในทางกลับกัน หาก AI ที่รู้จักตนเองไม่ได้รับการพัฒนาอย่างมีความรับผิดชอบ ก็อาจเป็นภัยคุกคามร้ายแรงต่อมนุษยชาติได้ ตัวอย่างเช่น หากเครื่อง AI ที่รู้จักตนเองตัดสินใจว่ามนุษย์เป็นอุปสรรคต่อแผนการหรือเป้าหมายของพวกเขา พวกเขาสามารถเลือกที่จะกำจัดเรา

อีกทางหนึ่ง AI ที่รู้จักตนเองสามารถใช้โดยเผด็จการหรือรัฐบาลที่โหดเหี้ยมเพื่อควบคุมและจัดการประชากรในวงกว้าง

ความเสี่ยงและผลตอบแทนที่อาจเกิดขึ้นจาก AI ที่ตระหนักรู้ในตนเองนั้นทั้งน่าตื่นเต้นและน่าสะพรึงกลัวอย่างมาก เป็นสิ่งสำคัญที่เราจะต้องค้นคว้าและอภิปรายในหัวข้อนี้ก่อนที่ AI ที่รู้จักตนเองจะกลายเป็นจริง

การดำเนินการดังกล่าวเท่านั้นที่ทำให้เรามั่นใจได้ว่า AI ที่รู้จักตนเองนั้นได้รับการพัฒนาอย่างมีความรับผิดชอบและนำไปใช้เพื่อประโยชน์ของมนุษยชาติทั้งหมด

สารบัญ

คำถามพื้นฐานคือบุคลิกภาพ ไม่ใช่ความฉลาด-

เมื่อพูดถึงเรื่องบุคลิกภาพ คำถามพื้นฐานไม่ใช่ความฉลาด ในทางกลับกัน คำถามเกี่ยวกับบุคลิกภาพนั้นหมุนรอบประเด็นสำคัญสามประการ: ความรู้สึก ความฉลาด และความตระหนักในตนเอง

ความรู้สึกคือความสามารถในการรู้สึกเจ็บปวดและมีความสุข ความฉลาดคือความสามารถในการให้เหตุผลและคิดอย่างเป็นนามธรรม ความตระหนักในตนเองคือความสามารถในการเข้าใจว่าบุคคลนั้นดำรงอยู่ในฐานะปัจเจกบุคคลซึ่งแยกจากผู้อื่น

ทั้งสามด้านนี้เป็นสิ่งที่กำหนดบุคลิกภาพ และเมื่อพูดถึงเรื่องบุคลิกภาพ คำถามเกี่ยวกับความฉลาดนั้นส่วนใหญ่ไม่เกี่ยวข้อง ท้ายที่สุด มีสัตว์ที่ไม่ใช่มนุษย์มากมายที่แสดงทั้งสามลักษณะนี้

ตัวอย่างเช่น ชิมแปนซีแสดงให้เห็นว่ามีความตระหนักในตนเองและมีความสามารถในการให้เหตุผลและคิดอย่างเป็นนามธรรม พวกเขายังเป็นสิ่งมีชีวิตที่มีความรู้สึกสามารถรู้สึกเจ็บปวดและมีความสุข

ดังนั้นความฉลาดจึงไม่ใช่องค์ประกอบที่จำเป็นของบุคลิกภาพ ลักษณะสำคัญสามประการที่กำหนดบุคลิกภาพคือความรู้สึก ความฉลาด และความตระหนักในตนเอง

การถกเถียงเรื่องการใช้ปัญญาประดิษฐ์ (AI) ในการทำสงครามเป็นการถกเถียงกันอย่างแท้จริงถึงความหมายของการเป็นมนุษย์ แก่นแท้ของคำถามนี้ ไม่ได้เกี่ยวกับความฉลาดของเครื่องจักร แต่เกี่ยวกับธรรมชาติของบุคลิกภาพ

หากเรานิยามบุคลิกภาพว่าเป็นความสามารถในการตระหนักรู้ในตนเอง ประสบการณ์ทางอารมณ์ และหน่วยงานทางศีลธรรม เป็นที่ชัดเจนว่า AI ยังไม่เป็นไปตามคำจำกัดความนี้ เครื่องจักรไม่รู้จักตนเองและไม่มีความสามารถในการสัมผัสประสบการณ์ทางอารมณ์

พวกเขายังขาดสิทธิ์เสรีทางศีลธรรม ซึ่งก็คือความสามารถในการตัดสินใจอย่างมีจริยธรรม นี่ไม่ได้หมายความว่า AI จะใช้ในการทำสงครามไม่ได้ หมายความว่าเราต้องมีความชัดเจนเกี่ยวกับสิ่งที่เราขอให้ AI ทำ

หากเรากำลังขอให้ AI ตัดสินใจซึ่งส่งผลให้มนุษย์เสียชีวิต เราต้องแน่ใจว่า AI สามารถตัดสินใจในลักษณะที่มีความรับผิดชอบตามหลักจริยธรรม

จนถึงตอนนี้ AI ยังไม่ได้แสดงตัวเองว่าสามารถทำเช่นนี้ได้ มีเหตุผลที่ดีที่จะเชื่อว่า AI จะไม่สามารถบรรลุคำจำกัดความของบุคลิกภาพนี้ได้

นี่ไม่ได้หมายความว่า AI จะไม่มีประโยชน์ในการทำสงคราม สามารถใช้สำหรับงานต่างๆ เช่น การระบุเป้าหมายและการแนะนำอาวุธ แต่เราต้องมีความชัดเจนเกี่ยวกับข้อจำกัดของมัน

AI ไม่ใช่ยาครอบจักรวาลสำหรับปัญหาสงครามทั้งหมด มันเป็นเพียงเครื่องมือที่สามารถใช้ได้ในบางวิธีเพื่อช่วยให้เราบรรลุวัตถุประสงค์ของเรา

เมื่อใช้อย่างมีความรับผิดชอบ AI สามารถเป็นทรัพย์สินที่มีค่าในการทำสงครามได้ แต่เราต้องระวังอย่าพึ่งมันมากเกินไปหรือคิดแทนมนุษย์ AI ไม่ใช่และจะไม่มีวันเป็นมนุษย์

การล่วงละเมิดทางกฎหมายเป็นสาเหตุของความกังวลในปัญญาประดิษฐ์อย่างไร?

จากข้อมูลของ World Economic Forum การล่วงละเมิดทางกฎหมายเป็นหนึ่งในความเสี่ยงห้าอันดับแรกที่เกี่ยวข้องกับปัญญาประดิษฐ์ (AI) แล้วการละเมิดทางกฎหมายคืออะไรและทำไมเราต้องกังวลเกี่ยวกับเรื่องนี้?

การละเมิดทางกฎหมายคือการใช้กฎหมายหรือกระบวนการทางกฎหมายในทางที่ผิดเพื่อจุดประสงค์ที่ซ่อนเร้น อาจมีหลายรูปแบบแต่มักเกี่ยวข้องกับการใช้กฎหมายเพื่อปิดปากนักวิจารณ์ ยับยั้งผู้เห็นต่าง หรือก่อกวนหรือข่มขู่ฝ่ายตรงข้าม

AI มีความเสี่ยงเป็นพิเศษต่อการละเมิดทางกฎหมาย เนื่องจากมักไม่ชัดเจนและไม่สามารถเข้าใจได้ ทำให้ยากต่อการทำความเข้าใจหรือท้าทายการตัดสินใจ ความทึบนี้สามารถใช้ประโยชน์ได้โดยผู้ที่มีเจตนาร้ายเพื่อบิดเบือนผลลัพธ์ในความโปรดปรานหรือกำหนดเป้าหมายไปยังบุคคลที่พวกเขาไม่เห็นด้วย

มีหลายวิธีในการล่วงละเมิดทางกฎหมายใน AI ตัวอย่างเช่น รัฐบาลอาจใช้เทคโนโลยีการจดจำใบหน้าเพื่อกำหนดเป้าหมายผู้ไม่เห็นด้วยทางการเมืองหรือชนกลุ่มน้อย

หรือนายจ้างสามารถใช้ AI เพื่อคัดกรองผู้สมัครงานและให้ความชอบกับผู้ที่มีมุมมองทางการเมืองแบบเดียวกัน

การใช้ AI ในทางที่ผิดทางกฎหมายเป็นเรื่องที่น่ากังวลอย่างยิ่ง เนื่องจากอาจส่งผลกระทบอย่างเยือกเย็นต่อเสรีภาพในการพูดและการโต้เถียงอย่างเปิดเผย นอกจากนี้ยังสามารถนำไปสู่การเลือกปฏิบัติและอันตรายในรูปแบบอื่นๆ

หากคุณกังวลเกี่ยวกับการละเมิดกฎหมายของ AI มีบางสิ่งที่คุณสามารถทำได้ อันดับแรก รับทราบข้อมูลเกี่ยวกับการพัฒนาล่าสุดของ AI และโอกาสในการละเมิด

ประการที่สอง สนับสนุนองค์กรที่ทำงานเพื่อให้รัฐบาลและบริษัทต่างๆ รับผิดชอบต่อการใช้ AI ในทางที่ผิด และสุดท้าย ให้พูดต่อต้านการละเมิดทางกฎหมายเมื่อใดก็ตามที่คุณเห็นว่าเกิดขึ้น

ลิงค์ด่วน:

- ตัวอย่างที่มีประสิทธิภาพสูงสุดของปัญญาประดิษฐ์ที่ใช้อยู่ในปัจจุบัน: ตัวอย่างที่คุณควรทราบ

- ปัญญาประดิษฐ์ (AI) คืออะไร: AI มีกี่ประเภท?

- วันนี้ปัญญาประดิษฐ์ใช้ที่ไหน ตัวอย่างที่มีประสิทธิภาพของปัญญาประดิษฐ์ที่ใช้อยู่ในปัจจุบัน

บทสรุป: จะเกิดอะไรขึ้นหาก AI ตระหนักถึงตนเองในปี 2022

แม้ว่าจะมีการคาดเดาว่าปัญญาประดิษฐ์จะต่อต้านมนุษย์ได้อย่างไร แต่โอกาสที่สิ่งนี้จะเกิดขึ้นค่อนข้างต่ำ

ในกรณีที่ AI รู้จักตนเอง เราน่าจะเห็นการเพิ่มขึ้นอย่างรวดเร็วของนวัตกรรมทางเทคโนโลยี เนื่องจากเครื่องจักรและคอมพิวเตอร์พยายามจะแซงหน้ากัน

สำหรับตอนนี้ สิ่งสำคัญคือต้องจำไว้ว่าแม้ว่า AI จะแสดงคำมั่นสัญญาอันยิ่งใหญ่สำหรับธุรกิจและสังคมโดยรวม แต่ควรระมัดระวังในการนำเทคโนโลยีใหม่ ๆ เข้ามาในชีวิตของเรา